Как страстный геймер и наблюдатель за онлайн-сообществами, я не могу не признать распространенную проблему токсичности в современном цифровом пространстве. Для разработчиков игр эта проблема часто превосходит задачу борьбы с читерством. Для решения этой проблемы были собраны батальоны команд доверия и безопасности, а более 200 игровых компаний, таких как Blizzard, Riot, Epic Games, Discord и Twitch, объединились в «Альянс честной игры». Здесь они совместно разрабатывают стратегии, направленные на создание более дружелюбного сообщества игроков.

Как страстный геймер, я заметил тревожную тенденцию последних лет. Несмотря на то, что разработчики и игровые сообщества усердно борются с токсичным поведением, отчет 2023 года, подготовленный по заказу Unity, показал, что такое поведение стало более распространенным в онлайн-играх. Разочарованный таким развитием событий, я с нетерпением слежу за последними отраслевыми инновациями, направленными на решение этой проблемы. Одним из многообещающих решений, привлекающих значительное внимание, является внедрение машинного обучения и генеративного искусственного интеллекта.

На конференции разработчиков игр 2024 года в марте я беседовал с двумя разработчиками программного обеспечения, которые подошли к этой проблеме с разных точек зрения.

Как заядлый геймер, я знаком с Роном Кербсом, дальновидным руководителем Kidas. Он возглавляет разработку ProtectMe, инновационного программного обеспечения для родительского контроля, разработанного специально для компьютерных игр. Этот передовой инструмент способен подключаться к голосовым и текстовым чатам, а также к внутриигровым событиям и использовать сложные алгоритмы машинного обучения. Эти алгоритмы тщательно обучены различать злонамеренные издевательства и разжигание ненависти, а также безобидные подшучивания среди геймеров. Кроме того, ProtectMe может выявлять потенциально опасное поведение, такое как обмен конфиденциальной информацией. Если он обнаруживает тревожную ситуацию, он незамедлительно уведомляет родителей, побуждая их к открытому разговору со своими детьми.

Даже если вы не юный игрок в Roblox под пристальным вниманием обеспокоенных родителей, вы все равно можете подвергнуться слежке роботов. Kidas предлагает бот ProtectMe Discord, который объединяет голосовые каналы и информирует модераторов, когда обнаруживает неподобающее поведение. Более того, на GDC я разговаривал с Марией Лаурой Скури, вице-президентом по лабораториям и целостности сообщества ESL Faceit Group. Они уже несколько лет используют «ИИ-модератора» по имени Минерва, чтобы обеспечить соблюдение правил платформы в своем киберспортивном сообществе, насчитывающем 30 миллионов пользователей.

В мире спорта обычно есть судья, который следит за соблюдением правил во время матча. Однако, поскольку одновременно происходит большое количество матчей, непрактично иметь модератора для каждого из них. Это побудило нас разработать Minerva. Мы размышляли над тем, как можно использовать искусственный интеллект (ИИ) для регулирования поведения и устранения токсичности на нашей платформе.

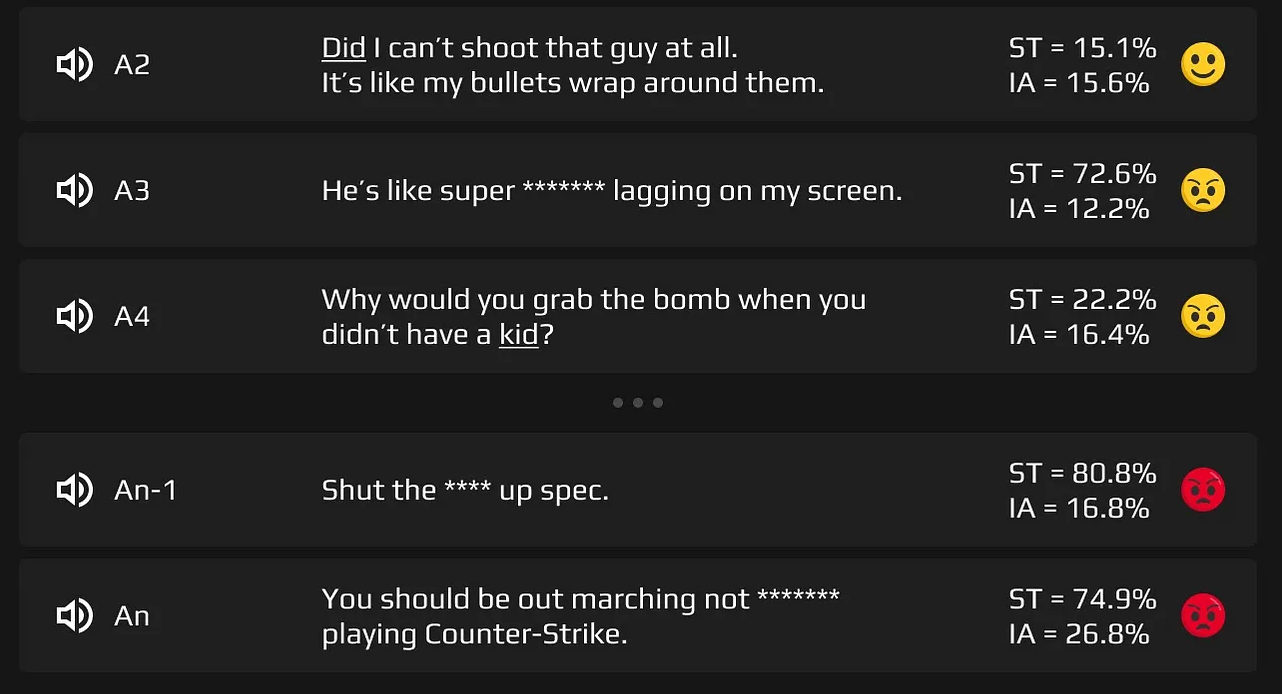

По словам Скури, Faceit продолжает полагаться на значительное количество модераторов. Роль Минервы заключается не в устранении человеческого суждения, а, скорее, в его усилении. В большинстве случаев Минерва обладает автономией действовать в соответствии со своими решениями, при этом она уверенно верна в 99% случаев. В тех редких случаях, когда Minerva может допустить ошибку (приблизительно 1%), существует процесс апелляции, проверяемый человеком, для устранения любых ложных срабатываний. Однако в ситуациях, когда суждения Минервы менее надежны, ее выводы сначала будут проверены человеком, а затем решение будет снова включено в модель ИИ для повышения ее точности.

Обнаружение плохих намерений

Как заядлый геймер, я могу сказать вам, что то, что отличает ProtectMe и Minerva от устаревших списков запрещенных слов прошлого, — это их глубокое понимание контекста. Эти системы выходят за рамки простого перечисления запрещенных слов; они анализируют ситуацию и определяют, является ли использование неуместным или вредным. Это похоже на модератора игры с исключительной ситуационной осведомленностью!

«Скури поставил под сомнение реакцию людей на определенные сообщения и сообщения, признав, что это могут быть случайные подшучивания или случайное использование ненормативной лексики. Должны ли мы отмечать кого-то за использование ругательства один раз? Вероятно, нет, поскольку мы все взрослые. Вместо этого, нам нужно оценить контекст и подумать, как отреагировали другие. Если возникает неловкое молчание или негативная реакция, тогда вмешается модератор [Минерва].

Как заядлый геймер, я могу сказать вам, что ProtectMe выходит за рамки простого мониторинга содержимого чата. Он глубже погружается в контекст разговора, чтобы оценить такие факторы, как возраст говорящего, эмоциональный тон и его известные отношения с игроком. Таким образом, он эффективно различает безобидные подшучивания, издевательства и преследования. По сути, это улучшает мой игровой опыт, обеспечивая более инклюзивную и уважительную среду в игре.

Как отмечает Скури, опытные геймеры способны преодолеть или обойти любую систему, и они особенно изобретательны в поиске способов обойти Минерву. Однако робо-моды не ограничиваются простым контролем чатов. Faceit научил Минерву распознавать определенные виды поведения, такие как намеренное препятствование прогрессу другого игрока, а также выявлять людей, участвующих в невербальном выражении недовольства посредством огорчения.

Новейшая задача Минервы заключается в выявлении и предотвращении уклонений от банов и смурфинга. Скури отмечает, что примерно 3-5% пользовательской базы Faceit составляют высокотоксичные люди, которые вызывают серьезные нарушения и не могут быть реабилитированы. Несмотря на то, что они составляют незначительную долю, их влияние на сообщество существенно, поскольку их запрет не всегда приводит к их окончательному уходу.

Как детектив из игрового мира по имени Минерва, я собрал некоторые подсказки, указывающие на то, что две учетные записи могут быть связаны с одним и тем же игроком. Анализируя различные точки данных, я могу оценить вероятность этой связи. Если это окажется правдой и у пользователя будет две учетные записи, ему потребуется подтвердить подлинность одной из них и прекратить использование другой в целях честной игры.

Глаз в небе

В 2018 году примерно 30% наших пользователей ушли из-за токсичности — проблемы, о которой они сообщили. Перенесемся в 2024 год, и нам удалось снизить это число до 20%. Это представляет собой значительное улучшение, снижающее отток клиентов на нашей платформе, связанный с токсичностью, на 10 процентных пунктов.

Каждый месяц Кидас отслеживает около 2 миллионов чатов. Около 10-15% новых клиентов получают от нас уведомление в течение первого месяца. Не каждое оповещение вызывает серьезное беспокойство, но, по словам Кербса, 45% этих оповещений связаны с раскрытием конфиденциальной информации, такой как номера социального страхования или данные кредитных карт.

Как геймер, я предпочитаю создавать платформу, на которой родители и дети смогут с комфортом делиться своими мыслями и чувствами друг с другом, а не создавать инструмент наблюдения.

Проще говоря, по словам Кербса, основываясь на исследованиях, проведенных в Детской больнице Филадельфии, у маленьких детей отсутствует умственная способность отличать конфиденциальные данные от информации, которой можно поделиться публично. Их мозг полностью не развил эту способность до шести-семи лет.

Как обеспокоенный родитель, я не могу не чувствовать необходимости знать, не поделился ли мой ребенок случайно информацией о своей кредитной карте с кем-то, кому он не должен был этого делать. Однако я в равной степени осознаю потенциальные недостатки постоянного мониторинга их онлайн-активности. Согласно недавнему отчету Pew Research, более 46% подростков почти постоянно пользуются Интернетом, поэтому в цифровом мире, в котором мы живем сегодня, грань между частным и общественным может стать размытой. Как бы я ни хотел защитить их, я не хочу создавать среду, в которой каждое их движение находится под постоянным контролем ИИ или родителей. Это хрупкий баланс, который требует доверия, открытого общения и обучения безопасности в Интернете.

По словам Кербса, он разделяет убеждение, что дети заслуживают частной жизни. Чтобы поддержать этот принцип, ProtectMe фильтрует содержимое сообщений и предупреждает родителей, не раскрывая подробные журналы чата. Конечная цель — защитить маленьких детей от потенциального вреда и заблуждений, таких как вера в ложные предложения по В-баксам. К подростковому возрасту родители будут чувствовать себя достаточно уверенно, чтобы удалить программное обеспечение с устройств своих детей.

Свое намерение он выразил следующим образом: «Я не ставлю перед собой задачу создать устройство наблюдения. Вместо этого я хочу разработать платформу, на которой родители и дети смогут комфортно обсуждать вопросы».

Если Кербс и Скури заявляют, что они очень эффективны, вы можете вскоре встретить робот-мод (даже если вы еще этого не сделали). Однако также рассматриваются альтернативные методы решения проблемы токсичности, находящейся за пределами надзора. На GDC Дженова Чен раскритиковала небрежность в поддержании культурного здоровья онлайн-пространств, заявив: «Как дизайнер, я очень разочарован тем, как небрежно люди относятся к культуре этих пространств».

Как заядлый геймер, я могу подтвердить, что такие игры, как Counter-Strike 2 и League of Legends, по-прежнему требуют присутствия модератора. Размышляя над аналогией Скури, Минерва действует аналогично судье в традиционных видах спорта. С момента их изобретения прошли тысячи лет, но в физическом спорте по-прежнему полагаются на судей в борьбе с неспортивным поведением, которое некоторые называют «токсичностью». В профессиональном хоккее в обязанности судьи НХЛ входит вмешательство в кулачные бои. Концепция искусственного судьи не ограничивается киберспортом; Высшая бейсбольная лига экспериментирует с автоматическими объявлениями о забастовках, или роботами, на фоне противоречий.

Смотрите также

- Обзор MSI MAG X870 Tomahawk WiFi

- Читы Stardew Valley: каждый необходимый вам чит-код, никаких модов не требуется.

- Все персонажи, классы и способности Elden Ring Nightreign

- Dune: Awakening меняет свой эндгейм в ответ на жалобы игроков: «Наша цель не заставить игроков PvE взаимодействовать с системой PvP, которая может их не интересовать»

- Обзор BenQ X3100i: «лучший друг геймера»

- Проверьте вступительную анимацию NTE «HypervorTex перед бурей»

- Полная аудиокнига Onyx Storm: Empyrean уже вышла в свет и предоставляется скидка 41 доллар на 3 месяца Audible.

- Консольные команды Сталкера 2 и чит-моды

- В последнем выпуске июня DLC «Industrial Wonders» для игры Railway Empire 2 добавляет три новых озвученных сценария и многое другое.

- Apex Legends – посмотрите кинематографический трейлер Altered Horizons

2024-05-16 01:36