Интересно отметить, что несмотря на то, что мы разработали и обучили большие языковые модели (LLM), их внутренние процессы остаются в значительной степени загадочными. Однако это стало меньше загадкой благодаря недавним исследованиям Anthropic, вдохновленным методами визуализации мозга и предоставляющим понимание того, почему чат-боты иногда выдают неточную информацию и испытывают трудности с численными задачами.

Проблема заключается в нашей неспособности до конца понять механизм работы огромных массивов весов и параметров внутри модели, а также то, как сложные связи между данными внутри модели, установленные через процесс обучения, приводят к внешне логичным результатам.

Согласно Джошуа Батсону, исследователю из Anthropic, как сообщает MIT Technology Review, когда вы заглядываете внутрь полностью обученной модели ИИ, она кажется больше похожей на огромную коллекцию чисел — параметров. Он описывает этот взгляд как не особенно озаряющий.

Для того чтобы получить ясную картину того, как развиваются события внутри системы, ученые из Anthropic разработали новый метод под названием трассировка схемы (circuit tracing). Этот подход позволяет им отслеживать этапы принятия решений в большой языковой модели в реальном времени. Впоследствии они применили этот метод к собственной Claude 3.5 Haiku LLM.

Как энтузиаст скажу, что мой любимый подход — Anthropic’s — вдохновлен методами сканирования мозга из нейронауки. По сути, он определяет элементы внутри модели, которые становятся активными в определенные моменты времени, подобно тому как сканер мозга выявляет активированные участки во время когнитивных процессов.

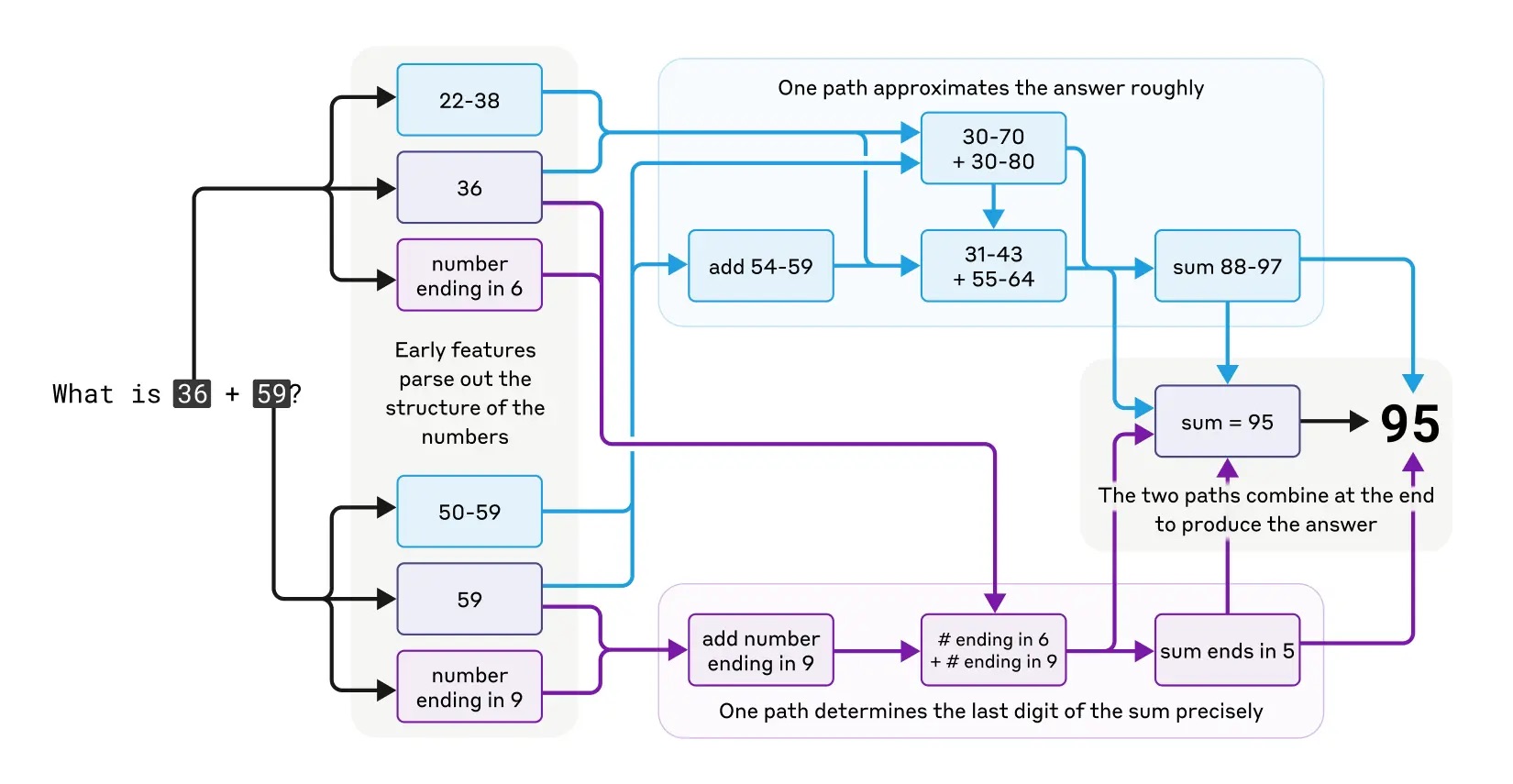

Команда Anthropic обнаружила интересные результаты при использовании этого метода, в частности раскрывая причины, по которым Большие Языковые Модели сталкиваются с трудностями фундаментальной математики. Например, когда модели просили сложить 36 и 59, они выбирали необычный путь, сначала прибавляя приблизительные значения (около 40 и 60, затем около 57 и 36). По ходу решения модель приходит к значению близкому к 92. Кроме того, другой расчет фокусируется на последних цифрах — 6 и 9, предполагая, что ответ должен заканчиваться на 5. Объединение этих двух результатов приводит к правильному итогу в 95, как объяснено в статье MIT.

Вот более прямолинейный способ объяснить это: Claude может объяснить, как он пришел к ответу 95, например, сначала сложив 6 и 9 (15), затем перенеся 1, а затем сложив десятки (3+5+1=9) для получения итогового результата. Однако этот метод не обязательно отражает конкретные расчеты, выполненные Claude; скорее, это представляет собой распространенный способ решения сумм, который он выучил во время обучения, так как мог найти ответ в своем датасете именно в таком формате.

Проще говоря, эта модель использует необычный подход к вычислениям, что вызывает сомнения. Более того, описания своих действий этой моделью недостаточно достоверны. Это критически важный момент, так как означает, что мы не можем слепо доверять результатам данной модели при разработке мер безопасности для ИИ. Важно также понимать внутренние процессы работы модели.

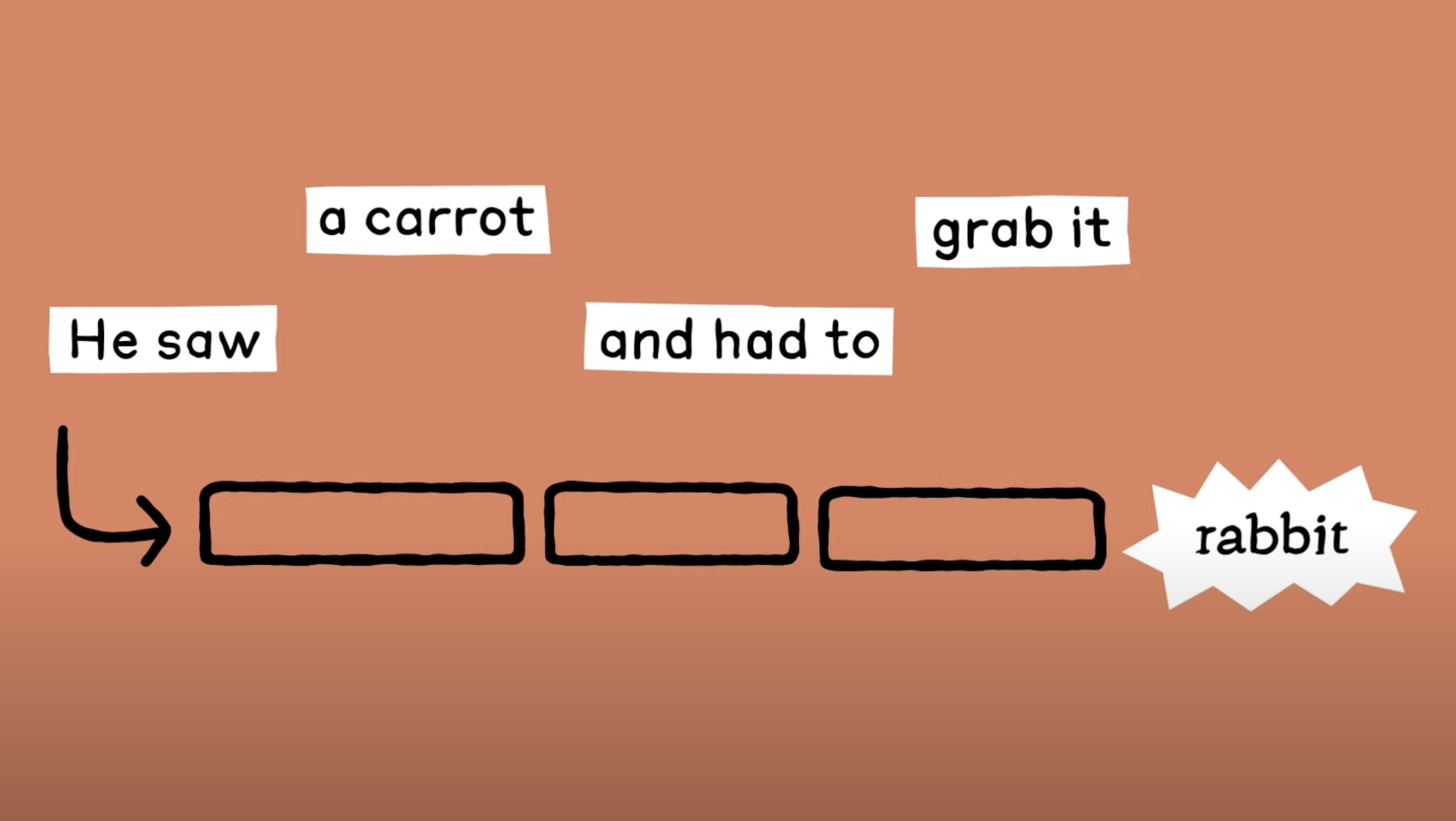

Одно интересное открытие исследования заключается в том, что эти модели обучения языку (LLM) не просто предполагают следующее слово, как обычно считают. Вместо этого, анализируя процесс создания рифмующихся двустиший Клодом, Anthropic обнаружил нетрадиционный метод: LLM сначала выбирают рифмующееся слово на конце строф, после чего завершают оставшуюся часть строки.

Как поклонник поэзии, я был просто поражен стратегическим подходом к составлению стихов. В отличие от поспешного подгонки рифм в конце стихотворения, кажется, что оно имеет четкую направленность на всем протяжении.

Кроме того, Anthropic обнаружил, что в некоторых случаях Клод размышляет на уровне понятий, который выходит за рамки отдельных языков, намекая на существование глобального ‘языка мысли.’

Похоже, впереди еще достаточно долгий путь в исследованиях этой области. Как отмечает Anthropic, понимание цепей, даже если они описаны всего десятками слов, требует значительного человеческого труда – до нескольких часов. Кроме того, исследования не раскрывают детали о том, как первоначально формируются внутренние структуры внутри больших языковых моделей (LLM).

Исследование их работы, хотя бы частично, проливает свет на функционирование этих загадочных ИИ-сущностей, которые мы создаем, но с трудом можем понять. Эта инсайд несомненно полезна.

1. Лучший CPU для игр: Ведущие процессоры от Intel и AMD.

2. Лучшая игровая материнская плата: Идеальные решения для вашей системы.

3. Лучшие видеокарты: Ваши идеальные пиксельные толкатели здесь!

4. Лучшее SSD для игр: Получите преимущество перед другими.

Смотрите также

- В хорошей новости для симуляторов убийств, в Inzoi есть 16 различных типов смертей.

- Читы Stardew Valley: каждый необходимый вам чит-код, никаких модов не требуется.

- Все местоположения призматических фрагментов Destiny 2

- Обзор ASUS ROG NUC 970

- Обзор Anycubic Kobra 3 Combo

- Третья книга «Клементины» обещает «душераздирающий финал» спин-оффа «Ходячих мертвецов»

- Обзор Arctic Liquid Freezer III 360 A-RGB

- Все пути восхождения Path of Exile 2 и как получить очки восхождения

- Обзор MSI Stealth 18 AI Studio: «пойман посередине»

- Коды дизайна персонажей Monster Hunter Wilds (Monster Hunter) { }

2025-03-28 19:32