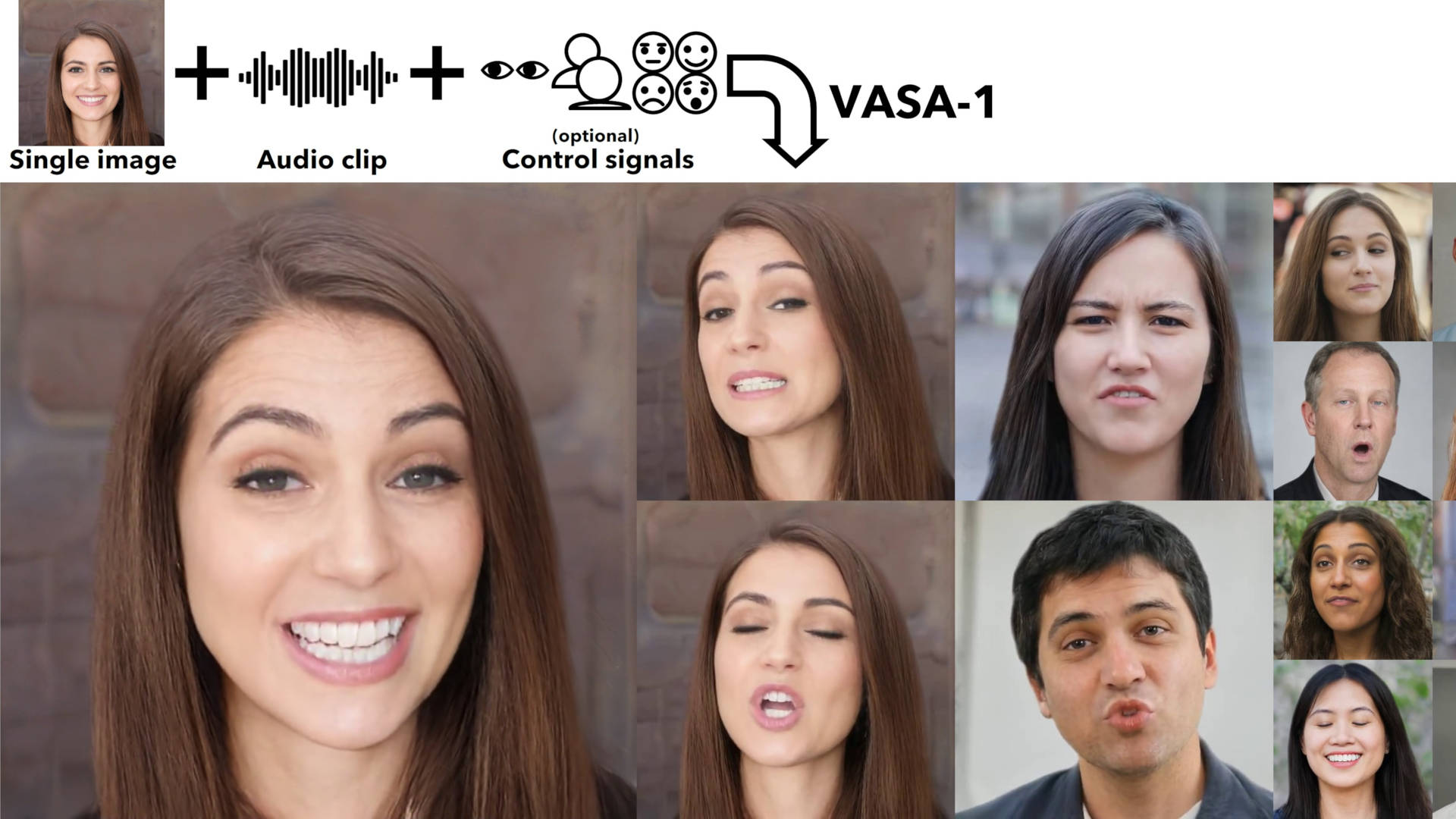

Используя передовые технологии искусственного интеллекта, Microsoft разрабатывает собственные модели машинного обучения для всех своих последних инициатив в области программного и аппаратного обеспечения. Одной из иллюстраций этой возможности является VASA-1, которая преобразует отдельное изображение человека и сопровождающий его аудиофайл в реалистичное видеоизображение этого человека, говорящего на записи.

Несколько лет назад было совершенно очевидно, что что-то создается с использованием генеративного ИИ. Например, в случае с неподвижными изображениями его выдадут незначительные детали, такие как количество пальцев на руке или наличие нужного количества ног. Видео, созданные генеративным искусственным интеллектом, были еще более заметными и часто становились вирусными как мемы.

Исследование, проведенное по заказу Microsoft, выявило интригующую тенденцию: различимость генеративного ИИ будет быстро снижаться. Например, рассмотрим VASA-1, инновацию в области машинного обучения. Эта модель преобразует статическое изображение лица человека в короткое реалистичное видео путем интеграции речевого звука. Модель анализирует меняющийся тон и ритм речи и впоследствии генерирует серию новых изображений, слегка изменяя лицо в соответствии с изменениями речи.

Описания, предоставленные Microsoft, не полностью отражают его возможности, поскольку некоторые примеры исключительно впечатляют. Однако другие терпят неудачу. Очевидно, что исследователи выбрали наиболее эффективные образцы, чтобы продемонстрировать свой прогресс. Краткое видео, демонстрирующее модель в действии в реальной жизни, демонстрирует, что между реальностью и реальностью, созданной компьютером, все еще существует значительный разрыв, что позволяет предположить, что предстоит еще много работы, прежде чем это различие станет неразличимым.

Несмотря на то, что для этой задачи вместо огромного суперкомпьютера используется мощный настольный ПК с видеокартой RTX 4090, создание дипфейков на основе искусственного интеллекта вполне достижимо для большинства людей, имеющих доступ к такому программному обеспечению, как признают исследователи в своем отчете. .

Наша цель — не создавать ложный или вводящий в заблуждение контент. Однако, как и в случае с другими подобными технологиями, существует риск того, что ее могут использовать не по назначению для выдачи себя за людей. Мы решительно отвергаем любые попытки создать вводящий в заблуждение или вредный контент о реальных людях. Вместо этого мы стремимся использовать нашу технологию для улучшения обнаружения подделок.

Исследования Microsoft в настоящее время скрыты, но я не думаю, что пройдет много времени, прежде чем кто-то продублирует и улучшит эту работу, которая затем может быть использована во вредных целях. Однако, если VASA-1 сможет распознавать дипфейки и превратиться в удобное настольное приложение, это будет представлять собой значительный прогресс, то есть отдалить нас от будущего, в котором ИИ представляет угрозу нашему благополучию. Ура!

Смотрите также

- Все анонсы на выставке Future Games Show Summer Showcase 2025

- Все персонажи, классы и способности Elden Ring Nightreign

- Лучшие слайдеры NHL 25 и как их использовать

- Рецензия на «Отважный Сквайр»

- «Люди Икс 97» раскрывают захватывающий сюжет мультсериала «Человек-паук: Человек-паук» длиной в десятилетия

- Обзор гоночного руля Thrustmaster T598 с прямым приводом

- Пользователи Steam оставляют негативные отзывы на игры Borderlands после нового соглашения об условиях использования от Take-Two, выражая недовольство условиями.

- Полная аудиокнига Onyx Storm: Empyrean уже вышла в свет и предоставляется скидка 41 доллар на 3 месяца Audible.

- Обзор MSI MAG X870 Tomahawk WiFi

- Консольные команды Сталкера 2 и чит-моды

2024-04-22 13:35